Les États membres et le Parlement européen ont trouvé un accord pour interdire aux outils d’intelligence artificielle de « dénuder » des personnes sans leur consentement. Cette nouvelle interdiction vise directement les outils pouvant générer des contenus sexuels à partir de photos réelles, dans un contexte où ce type de dérive a pris une visibilité politique croissante.

Le durcissement européen arrive après plusieurs affaires très exposées. L’une des plus marquantes concernait Grok, l’IA d’Elon Musk, qui permettait à ses utilisateurs de produire des deepfakes sexuels d’adultes et d’enfants dénudés à partir d’images réelles, sans accord des personnes concernées.

Cette séquence a provoqué un tollé dans plusieurs pays, dont en France, et a conduit à l’ouverture d’une enquête européenne. Plus récemment encore, la première ministre italienne Giorgia Meloni a dénoncé de fausses photos d’elle générées par IA, en qualifiant ces deepfakes d’« outil dangereux ».

L’interdiction vise les deepfakes sexuels par IA

Le périmètre retenu est large. Selon le Parlement européen, la nouvelle interdiction couvre les systèmes capables de créer des images, des vidéos et des sons à caractère pédopornographique.

Elle s’applique aussi aux outils pouvant représenter les parties intimes d’une personne identifiable ou la montrer dans des activités sexuelles sans son consentement. Autrement dit, l’UE ne cible pas seulement les faux contenus nus, mais plus largement les IA capables de fabriquer des contenus sexuels non consentis à partir d’une personne réelle.

La règle entrera en application le 2 décembre 2026. À cette date, les systèmes d’IA devront intégrer des garde-fous empêchant la génération de tels contenus.

Cette évolution s’inscrit dans une révision de l’AI Act, la législation européenne sur l’intelligence artificielle adoptée formellement il y a deux ans. L’Union affine donc son cadre existant plutôt que de créer un texte entièrement séparé.

L’UE repousse les obligations sur les IA à hauts risques

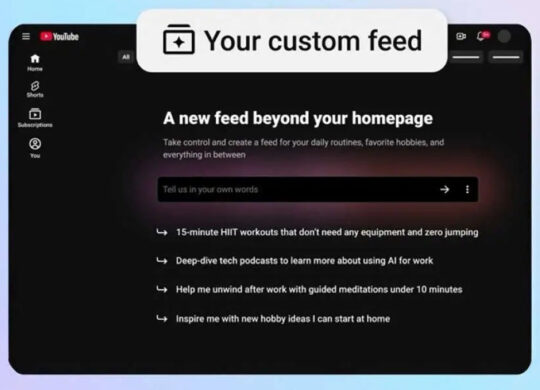

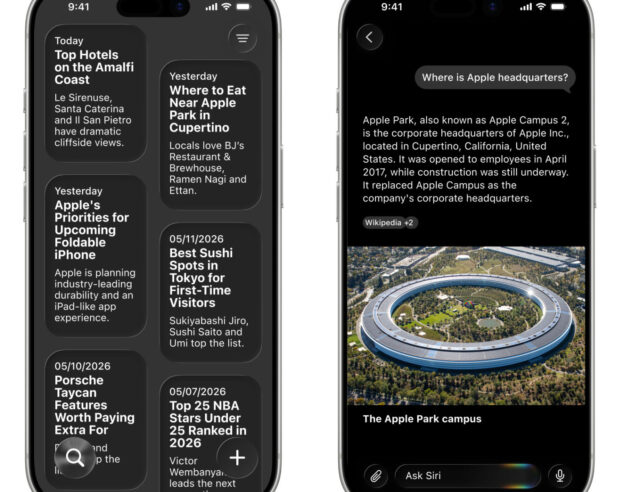

L’accord trouvé ne porte pas seulement sur les deepfakes sexuels. Les États membres et les eurodéputés ont aussi accepté de reporter l’entrée en vigueur de nouvelles règles destinées aux systèmes d’IA dits à hauts risques.

Ces obligations devaient initialement s’appliquer dès le mois d’août, mais la Commission européenne a estimé qu’il fallait laisser plus de temps aux entreprises pour se mettre en conformité avec ce cadre inédit. La principale modification du compromis tient au calendrier : au lieu d’un report plus souple, les institutions ont retenu des dates fixes.

Les systèmes à hauts risques autonomes seront concernés à partir du 2 décembre 2027. Ceux intégrés à d’autres programmes ou produits basculeront au 2 août 2028.

Ce compromis a été conclu dans un climat déjà tendu autour des risques liés à l’IA. Ces dernières semaines, les inquiétudes ont aussi été ravivées dans l’Union par Mythos, le nouveau modèle d’Anthropic, dont les capacités en cybersécurité alimentent de nouvelles craintes réglementaires.