Meta entame un virage majeur dans la modération de ses réseaux sociaux : le groupe (Facebook, Instagram) annonce vouloir réduire fortement sa dépendance aux modérateurs humains au profit de systèmes d’intelligence artificielle, notamment fondés sur des modèles de langage (LLMs). Le géant américain estime que l’IA peut repérer davantage de contenus problématiques, plus vite, tout en limitant les erreurs de sur-modération.

Une modération « pilotée par l’IA »

La transition ne se fera pas du jour au lendemain. Meta évoque un changement progressif « au cours des prochaines années », avec un recours accru à l’IA pour traiter les signalements et détecter les infractions à très grande échelle. Jusqu’ici, la plateforme s’appuyait déjà sur des algorithmes, mais aussi sur des milliers de prestataires chargés d’examiner les contenus remontés par les outils automatiques ou par les utilisateurs.

Humains maintenus sur les décisions les plus sensibles

Meta assure néanmoins que l’humain restera indispensable pour les cas à fort enjeu. Les équipes spécialisées conserveraient un rôle central dans les appels (comptes désactivés, litiges), les arbitrages complexes et, le cas échéant, les signalements aux autorités. En coulisses, ces experts continueront aussi de concevoir, entraîner et évaluer les systèmes d’IA.

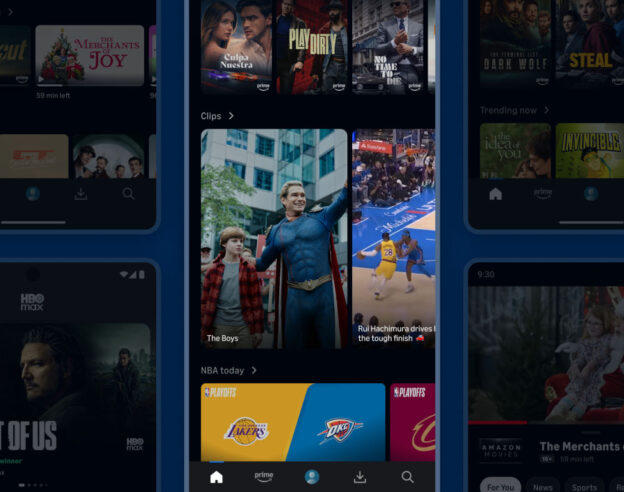

Un assistant IA pour aider les utilisateurs

En parallèle, Meta déploie un assistant d’assistance basé sur l’IA dans Facebook et Instagram. Ce dernier doit faciliter certaines démarches courantes : signaler un contenu, gérer un recours, récupérer un compte, réinitialiser un mot de passe ou expliquer des paramètres.

La promesse d’une modération plus rapide et plus cohérente résistera-t-elle aux cas ambigus, aux contextes culturels et aux tentatives de contournement ? Meta joue gros, surtout dans un contexte où l’IA n’a jamais été autant décriée par le grand public (parfois jusqu’à l’absurde).

Un commentaire pour cet article :