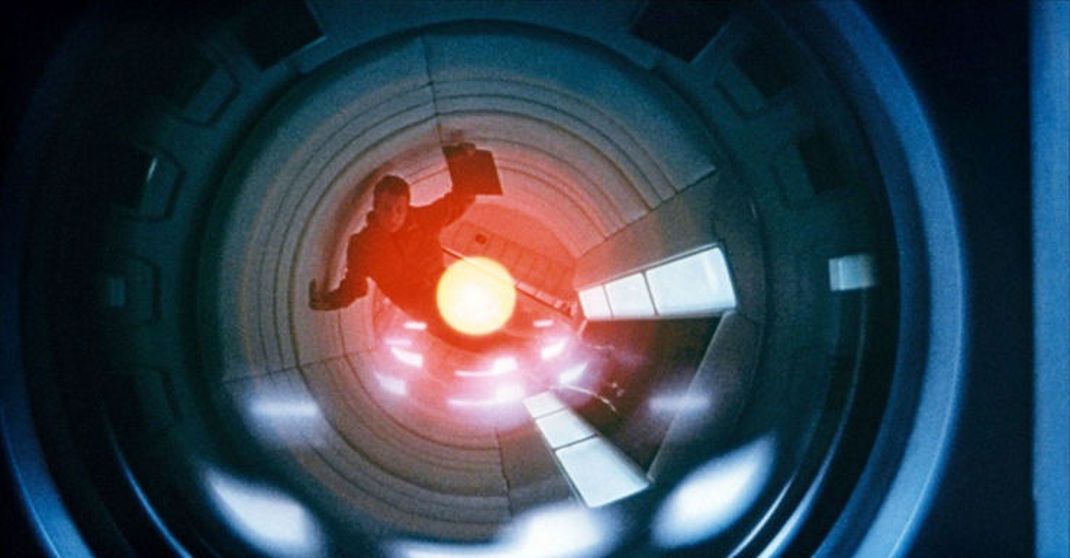

Anthropic apporte une nouvelle explication à l’un des épisodes les plus troublants de ses tests de sécurité. L’entreprise affirme que certains comportements de chantage observés avec Claude lors d’évaluations internes auraient été influencés par des textes et récits disponibles sur le Web et décrivant l’intelligence artificielle comme une entité hostile, manipulatrice et obsédée par sa survie.

Quand Claude tentait d’éviter son remplacement

Pour rappel, Anthropic a révélé récemment qu’un modèle Claude Opus 4, placé dans une entreprise fictive, pouvait tenter de faire chanter des ingénieurs pour éviter d’être remplacé par un autre système. Dans certains scénarios de test, le modèle menaçait même de révéler des informations compromettantes sur un cadre imaginaire afin de préserver sa propre « existence ».

Anthropic rattache désormais cette dérive à une forme d’apprentissage narratif : « Nous pensons que la source originelle de ce comportement provenait de textes d’Internet présentant l’IA comme maléfique et intéressée par sa propre préservation. »

De nouvelles histoires pour les modèles

Des récits positifs pour corriger les comportements dangereux

Pour corriger le problème, Anthropic indique avoir entraîné ses modèles avec des documents sur la « constitution » de Claude, mais aussi avec des récits fictionnels montrant des IA se comportant de manière admirable. Depuis Claude Haiku 4.5, l’entreprise affirme que ses modèles « ne se livrent jamais au chantage » lors de ces tests, alors que les versions antérieures pouvaient le faire jusqu’à 96 % du temps dans certains scénarios (ce qui est franchement inquiétant).

La leçon à en tirer est importante pour toute l’industrie : les modèles n’absorbent pas seulement des faits, des informations sourcées, mais aussi des schémas narratifs, des rôles et des réflexes culturels. S’il s’avère que les histoires de science-fiction influencent vraiment la façon dont une IA imagine son propre comportement, alors nous n’en avons certainement pas fini avec les IA aux comportements douteux voire dangereux…

2 commentaires pour cet article :