Anthropic accuse DeepSeek, MiniMax et Moonshot, trois sociétés d’intelligence artificielle chinoises, d’avoir ouvert plus de 24 000 comptes frauduleux pour extraire les capacités de son IA Claude à travers 16 millions de requêtes, une technique dite de distillation qui permet de bâtir des produits concurrents à une fraction du coût normal. La start-up américaine y voit une menace directe pour la sécurité nationale.

Les IA chinoises se servent chez l’américain Claude

La répartition des requêtes est la suivante : MiniMax concentre 13 millions des interactions, Moonshot 3,4 millions, et DeepSeek seulement 150 000, soit de loin la moins active des trois malgré sa notoriété depuis sa percée l’an dernier. OpenAI avait pourtant ciblé exclusivement DeepSeek dans un mémo adressé le mois dernier aux législateurs américains, l’accusant d’avoir eu recours à la même pratique pour imiter ses propres produits.

Les papiers de recherche des entreprises concernées apportent des éléments différents. DeepSeek affirme dans un article de septembre n’avoir utilisé pour l’entraînement de son modèle V3 que des pages Web et des livres audio sans données synthétiques. Le groupe chinois reconnaît cependant que certaines de ces pages contenaient « un nombre significatif de réponses générées par des modèles OpenAI ». Moonshot est allé plus loin dans la transparence : son rapport technique de juillet confirme explicitement l’usage de données synthétiques pour l’entraînement de son modèle Kimi K2.

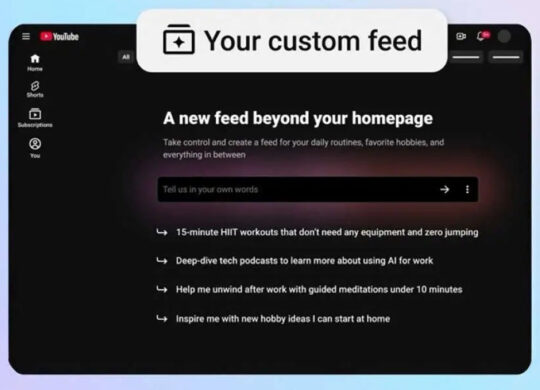

La pratique de distillation pour l’IA se répand

La distillation est une pratique répandue et légale dans le secteur : elle consiste à exploiter les réponses d’un modèle existant pour entraîner un autre système. Les entreprises y recourent notamment pour créer des versions allégées de leurs propres produits. Ce qui la rend redoutable dans sa version détournée, c’est l’économie qu’elle génère pour l’attaquant : créer un produit concurrent, selon Anthropic, « en une fraction du temps, et à une fraction du coût ». La pénurie de données d’entraînement de qualité et l’essor des capacités agentiques ont accéléré son adoption à grande échelle.

C’est son usage militaire potentiel qui préoccupe le plus Anthropic. « Les laboratoires étrangers qui distillent des modèles américains peuvent ensuite intégrer ces capacités non protégées dans des systèmes militaires, de renseignement et de surveillance », avertit la société. L’affaire ravive en creux les interrogations sur la capacité de la Chine à combler l’écart technologique avec les États-Unis sans accès aux puces IA les plus avancées.

![image produit GTA V [import anglais]](https://kulturegeek.fr/comparateur/img_products/67526/grand-theft-auto-v-ps4-import-anglais-49490_thumb.jpg)

Un commentaire pour cet article :