Google présente Gemma 4 comme sa famille de modèles IA ouverts la plus intelligente à ce jour, qui se base à partir des mêmes travaux de recherche que Gemini 3. L’entreprise met aussi en avant la dynamique déjà acquise avec plus de 400 millions de téléchargements depuis la première génération et plus de 100 000 variantes créées par la communauté.

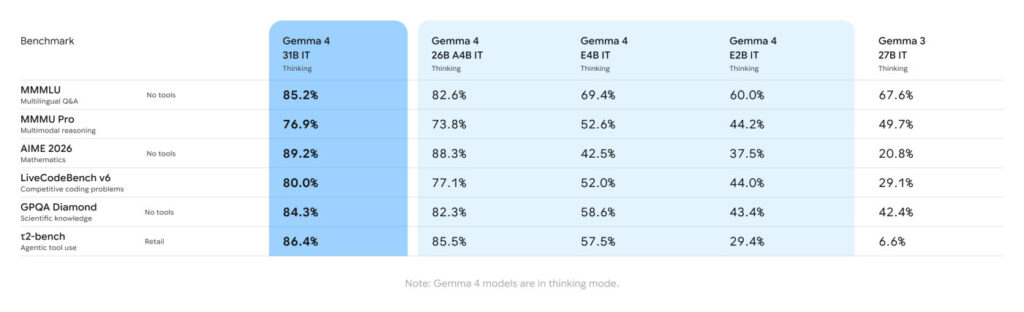

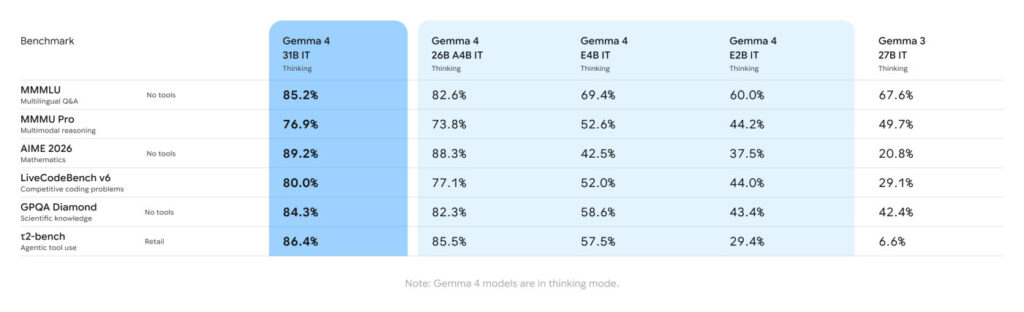

Gemma 4 se décline en quatre formats, avec les versions Effective 2B, Effective 4B, 26B Mixture of Experts et 31B Dense. Google affirme que les modèles les plus imposants atteignent un niveau de référence dans leur catégorie, avec le 31B classé troisième modèle ouvert mondial sur le classement textuel d’Arena AI et le 26B en sixième position. Le groupe soutient même que Gemma 4 dépasse sur ce terrain des modèles jusqu’à 20 fois plus volumineux.

Google cible d’abord l’IA locale avec Gemma 4

L’un des choix les plus notables de Gemma 4 tient à son positionnement. Google explique avoir dimensionné ces modèles pour qu’ils puissent être exécutés et ajustés efficacement sur des appareils Android, des puces graphiques (GPU) d’ordinateurs portables, des stations de travail de développeurs et des accélérateurs plus puissants.

Les deux petits modèles, E2B et E4B, concentrent cette stratégie. Google les présente comme des modèles multimodaux optimisés pour la faible latence et l’efficacité mémoire, avec une exécution entièrement hors ligne sur des téléphones, des Raspberry Pi, des machines Nvidia et des Jetson Orin Nano. Android peut déjà servir de terrain d’essai à ces usages via l’AICore Developer Preview, pensé pour préparer la compatibilité avec Gemini Nano 4.

Les modèles plus lourds visent un autre public. Le 26B Mixture of Experts privilégie la rapidité en n’activant que 3,8 milliards de paramètres pendant l’inférence, tandis que le 31B Dense est présenté comme la base la plus solide pour le réglage fin et la qualité brute. Google précise aussi que les poids bfloat 16 non quantifiés tiennent sur un seul GPU Nvidia H100 de 80 Go.

Un modèle ouvert, mais pensé pour les agents

Google ne présente pas Gemma 4 comme un simple concurrent de chatbot IA. L’entreprise insiste sur le raisonnement avancé, la planification en plusieurs étapes, la génération de code hors ligne et les flux agentiques. La famille de modèles prend en charge nativement l’appel de fonctions, la sortie JSON structurée et les instructions système, trois briques destinées à construire des agents capables d’interagir avec des outils et des API.

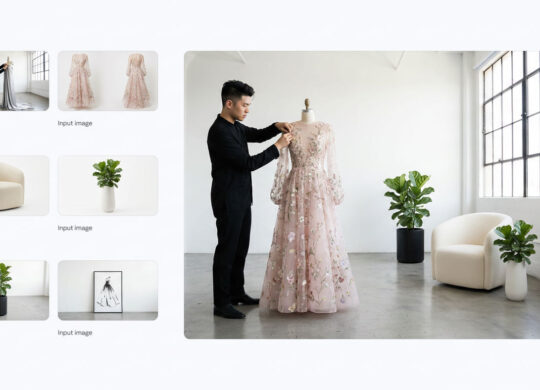

Gemma 4 élargit aussi son champ multimodal. Tous les modèles traitent nativement les images et la vidéo, avec des performances mises en avant sur l’OCR et la compréhension de graphiques, tandis que les versions E2B et E4B ajoutent une entrée audio native pour la reconnaissance et la compréhension de la parole. Google ajoute une fenêtre de contexte de 128 000 tokens pour les modèles edge et jusqu’à 256 000 tokens pour les modèles plus grands.

En outre, Google publie Gemma 4 sous licence Apache 2.0, en insistant sur une flexibilité commerciale, un contrôle total sur les données, l’infrastructure et les modèles, ainsi qu’un déploiement possible sur site ou dans le cloud. Cette ouverture s’accompagne d’une promesse de sécurité, le groupe affirmant appliquer à Gemma 4 les mêmes protocoles rigoureux que pour ses modèles propriétaires.

Enfin, Google verrouille l’écosystème dès le lancement. Gemma 4 est disponible dans Google AI Studio, Google AI Edge Gallery, Hugging Face, Kaggle ou Ollama, avec une compatibilité annoncée dès le départ avec des outils comme Transformers, vLLM, llama.cpp, MLX, Keras, Docker ou Nvidia NIM.

I’m new to the blog world but I’m trying to get started

and set up my own. Do you require any coding expertise to make your

own blog? Any help would be really appreciated!