Anthropic, le créateur du chatbot Claude, a annoncé une mise à jour de ses conditions d’utilisation et de sa politique de confidentialité. Désormais, les conversations des utilisateurs pourront être utilisées pour entraîner l’intelligence artificielle, avec une option de désactivation pour ceux qui le souhaitent.

Vous pouvez refuser d’entraîner Claude avec vos messages

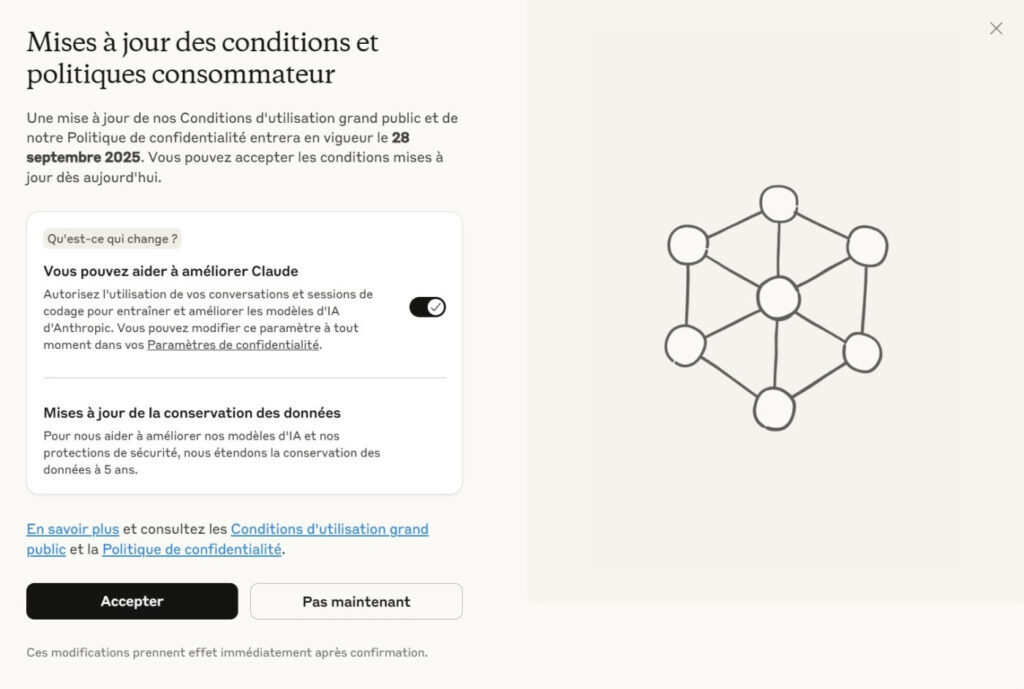

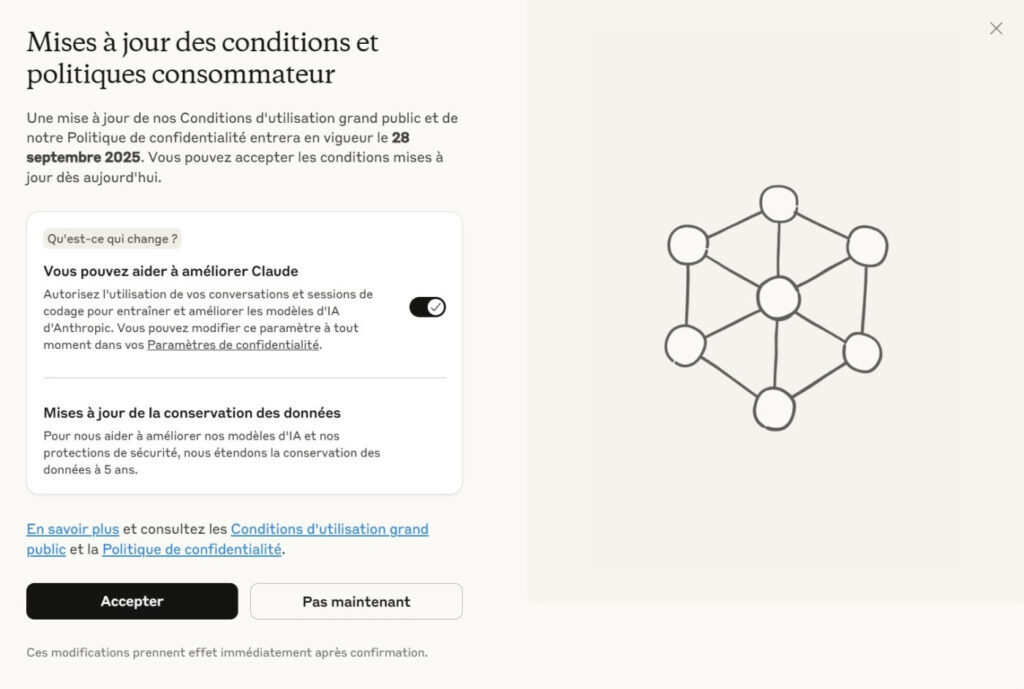

Les nouveaux utilisateurs pourront refuser l’utilisation de leurs données dès leur inscription. Pour les utilisateurs existants, une fenêtre contextuelle intitulée « Mises à jour des conditions et politiques consommateur » apparaît, leur permettant de désactiver l’option « Vous pouvez aider à améliorer Claude ». En décochant cette option, les conversations ne seront pas utilisées pour entraîner l’IA. Ceux qui acceptent verront leurs nouvelles discussions, ou celles existantes, utilisées par Anthropic. Les utilisateurs doivent faire un choix d’ici le 28 septembre 2025 pour continuer à utiliser Claude.

Il est également possible de désactiver cette option via les paramètres de Claude, en sélectionnant l’onglet Confidentialité et en désactivant « Aider à améliorer Claude ». Cette flexibilité vise à donner aux utilisateurs le contrôle sur leurs données tout en permettant à Anthropic d’améliorer ses modèles.

Une politique pour des modèles plus performants

Anthropic justifie cette nouvelle politique par la nécessité de développer des « modèles d’IA plus performants et utiles », tout en renforçant les protections contre les usages nuisibles comme les arnaques ou les abus. Les conditions mises à jour s’appliquent à tous les abonnements (Claude gratuit, Pro et Max), mais pas aux services avec des liens commerciaux comme Claude pour le travail ou Claude pour l’éducation.

En plus de l’utilisation des transcriptions de conversations pour l’entraînement, Anthropic prolonge la durée de conservation des données à cinq ans pour ceux qui acceptent de partager. Les conversations supprimées ne seront pas utilisées pour l’entraînement futur, et pour ceux qui refusent, la rétention reste limitée à 30 jours comme actuellement. Anthropic précise qu’une combinaison d’outils et de processus automatisés filtrera les données sensibles, sans partage avec des tiers.

Avant cette annonce, Anthropic n’utilisait les conversations des utilisateurs pour améliorer Claude que si ceux-ci soumettaient des réactions. Ce virage vers l’utilisation des données par défaut, avec une option de désactivation, marque une évolution dans la stratégie de l’entreprise.