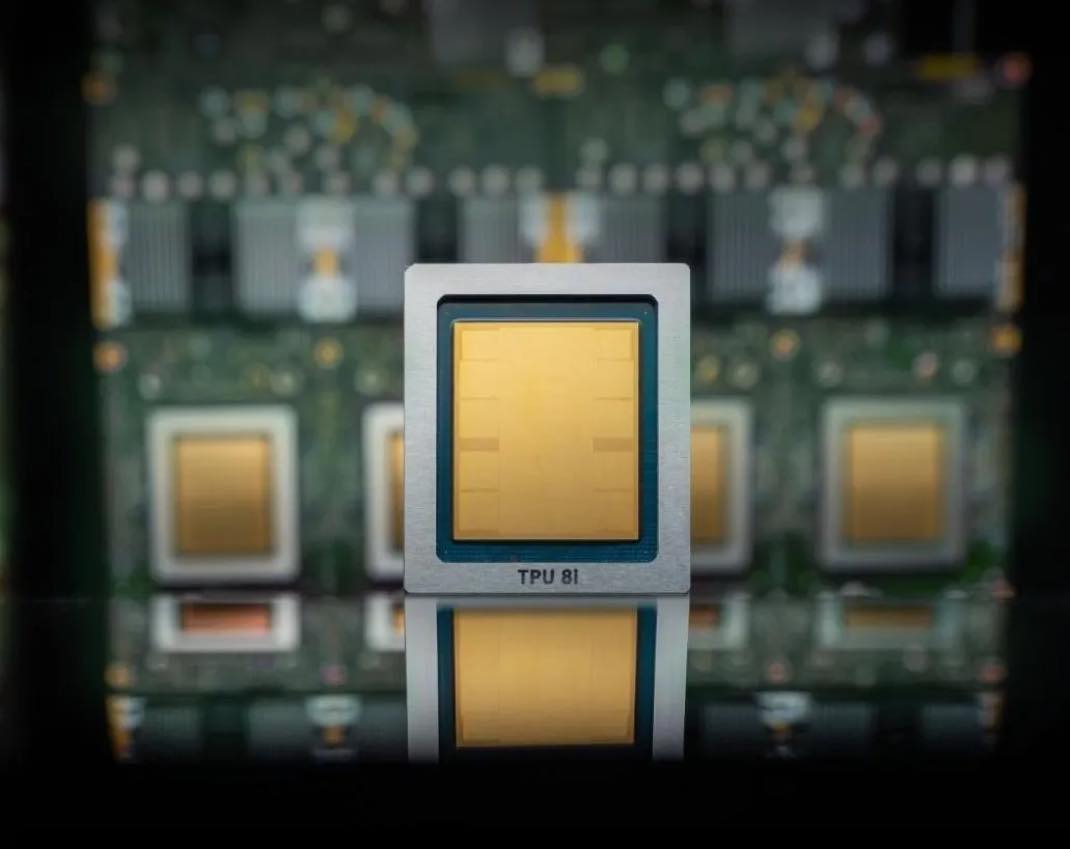

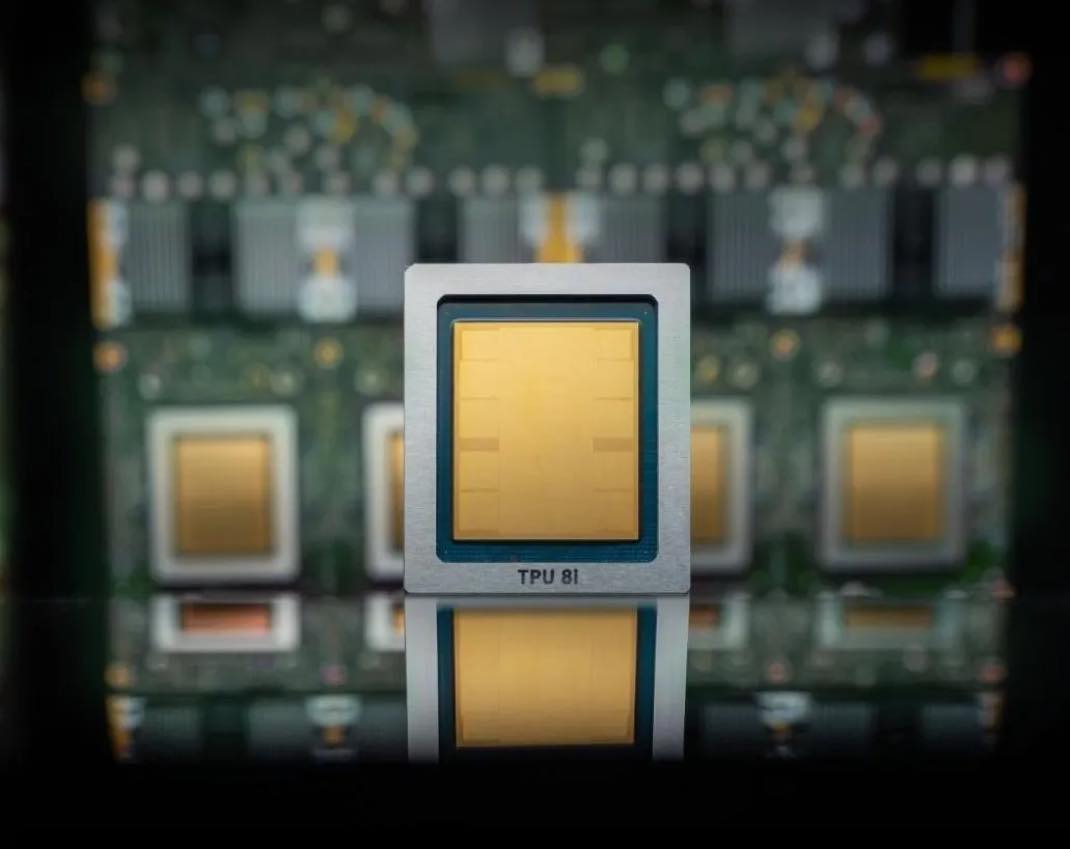

Google Cloud muscle son arsenal dans la bataille de l’intelligence artificielle avec le lancement de deux nouvelles puces maison, conçues pour répondre à deux besoins désormais bien distincts du marché. D’un côté, le TPU 8t pour l’entraînement des modèles, de l’autre, le TPU 8i pour l’inférence, c’est-à-dire l’exécution concrète des modèles une fois ces derniers déployés.

Google veut offrir plus de calcul, pour moins d’énergie et de coût

La firme de Mountain View met en avant des gains très ambitieux : Google promet jusqu’à trois fois plus de vitesse pour l’entraînement, une amélioration de 80 % du rapport performance-prix et la possibilité de faire fonctionner plus d’un million de TPU au sein d’un même cluster. Le géant américain veut convaincre les clients cloud que son silicium maison peut offrir davantage de puissance tout en réduisant la facture énergétique et financière, ce que l’on appelle communément un argument « massue ».

Cette annonce s’inscrit dans une stratégie plus large de maîtrise de l’infrastructure. En concevant ses propres accélérateurs, Google espère mieux contrôler les coûts, différencier son service de cloud et attirer les entreprises qui cherchent à industrialiser leurs usages/services d’IA.

Nvidia reste toutefois un partenaire incontournable

Pour autant, il serait prématuré de voir dans ces puces maison une rupture frontale avec Nvidia. Google ne remplace pas brutalement les GPU du champion américain : il les complète. L’entreprise a même confirmé qu’elle proposerait plus tard cette année les systèmes Vera Rubin de Nvidia dans son cloud. En parallèle, les deux groupes continuent de collaborer sur les réseaux et l’optimisation des infrastructures.

Une concurrence qui reste, pour l’instant, une cohabitation

C’est tout le paradoxe du moment. Les hyperscalers comme Google, Microsoft ou Amazon développent leurs propres puces pour réduire leur dépendance à Nvidia, mais continuent dans le même temps d’acheter et d’intégrer massivement ses technologies. À court terme, l’essor de Google Cloud dans l’IA peut donc encore profiter à Nvidia autant qu’il fait le jeu de concurrence.