En 2025, l’intelligence artificielle n’est plus un simple outil dans l’industrie musicale : elle devient une source massive de contenus, un défi opérationnel pour les plateformes et un sujet de confiance pour les auditeurs. Le streaming se retrouve face à une équation nouvelle : accueillir l’innovation (assistants de création, mastering automatisé, personnalisation avancée) sans laisser l’écosystème être submergé par des flux de morceaux entièrement générés, parfois utilisés à des fins de spam ou de fraude.

Les plateformes de streaming doivent désormais répondre à des questions très concrètes : comment signaler clairement un titre généré par IA ? Comment distinguer une œuvre humaine, une œuvre « assistée » et une œuvre 100 % synthétique ? Qui est rémunéré, et selon quelles règles, quand le volume de contenus explose ? Et surtout : comment préserver une découverte musicale utile, dans un catalogue où la quantité peut écraser la qualité ?

- Transparence : étiquetage, métadonnées et signaux visibles pour le public.

- Identification : distinguer humain, IA assistée et 100 % IA, sans simplifier à l’excès.

- Éthique et rémunération : droits d’auteur, fraude et nouveaux modèles de partage de la valeur.

- Découverte : recommandations, filtres et lutte contre le « bruit » dans les catalogues.

- Usages : ce que l’IA change réellement pour les auditeurs au quotidien.

Pourquoi l’IA est-elle devenue un sujet central du streaming musical en 2025 ?

La bascule s’explique d’abord par une réalité simple : produire une chanson convaincante est devenu beaucoup plus accessible. Là où la création musicale demandait hier un minimum de compétences techniques et de temps, des outils génératifs permettent aujourd’hui de fabriquer des titres « prêts à streamer » à grande échelle. Résultat : l’enjeu n’est pas uniquement artistique, il devient industriel.

Une explosion des volumes… qui ne dit pas tout de l’écoute

Le phénomène le plus marquant est la proportion de titres livrés quotidiennement aux plateformes et identifiés comme entièrement générés par IA. Deezer, qui communique régulièrement sur le sujet, a indiqué au fil de 2025 une montée très rapide de ces flux, jusqu’à représenter une part significative des envois quotidiens. Selon la plateforme, 28 % de la musique livrée aux plateformes de streaming est désormais entièrement générée par l’IA. Dans le même temps, cette abondance de contenus ne se traduit pas mécaniquement par la même part d’écoutes : l’attention des utilisateurs reste limitée, et la visibilité dépend fortement des systèmes de recommandation.

Un problème de confiance, pas seulement de technologie

La difficulté, pour les plateformes, est que la frontière devient de plus en plus floue à l’oreille. Quand l’auditeur ne sait plus ce qu’il écoute, le risque est celui d’une « crise de l’authenticité » : sentiment d’être trompé, perte de repères, confusion autour de l’attribution et de l’intention artistique. L’étude Ipsos x Deezer illustre ce brouillage : 97 % des personnes seraient incapables de faire la différence entre une musique entièrement générée par l’IA et une musique créée par des humains. La transparence n’est donc pas un détail de présentation : elle devient un élément de confiance, comparable à l’affichage de la qualité audio, des crédits ou des informations sur un album.

Comment les plateformes rendent-elles la musique générée par IA plus transparente ?

La transparence peut prendre plusieurs formes : un label visible dans l’application, des informations dans les crédits, une catégorie spécifique, ou encore des filtres permettant de masquer certains contenus. En 2025, on observe une tendance nette : les services cherchent à éviter le binaire « IA / pas IA » au profit d’un affichage plus nuancé, à condition de pouvoir s’appuyer sur des informations fiables.

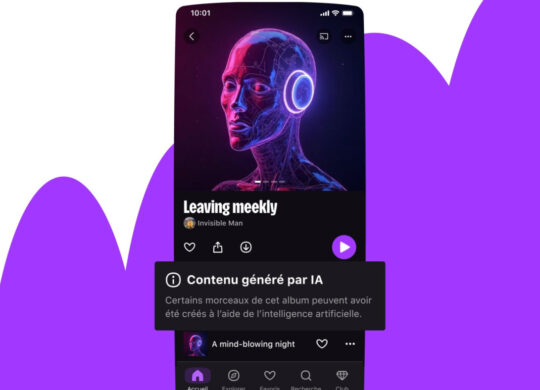

Deezer comme cas d’école : étiquetage et détection

Deezer a mis en avant un système d’étiquetage visant à identifier les albums contenant des titres générés par intelligence artificielle. L’objectif affiché est double : donner un repère clair aux auditeurs, et éviter que l’afflux de contenus 100 % synthétiques ne déstabilise la découverte musicale. La plateforme de streaming Deezer insiste également sur la détection (capacité à reconnaître des morceaux issus de certains générateurs) et sur une stratégie consistant à limiter la mise en avant algorithmique de contenus entièrement générés.

Vers des standards de métadonnées : l’exemple des crédits « IA »

Une autre approche gagne du terrain : faire remonter l’information via les métadonnées et les crédits, afin que l’écosystème (labels, distributeurs, plateformes) parle un langage commun. Spotify a notamment annoncé son soutien à un standard de divulgation de l’usage de l’IA dans les crédits, avec l’idée de préciser si l’IA a servi aux voix, à l’instrumentation, ou à des étapes de post-production. L’enjeu est important : si l’information est normalisée, elle devient affichable partout, de manière cohérente, et moins dépendante d’un simple badge isolé.

La transparence ne se limite pas au streaming audio

Sur l’univers YouTube, la logique de divulgation existe aussi : la plateforme impose la déclaration des contenus altérés ou synthétiques lorsqu’ils paraissent réalistes, avec un affichage d’étiquette dans l’environnement de publication. Même si YouTube est d’abord un service vidéo, ces règles illustrent une dynamique plus large : à mesure que l’IA permet de produire des contenus plausibles, les services cherchent des mécanismes standardisés pour informer le public.

Comment distinguer « IA assistée » et « 100 % IA » sans tomber dans le piège du tout-ou-rien ?

La question est cruciale car, dans la vraie vie, la création musicale s’étale sur un spectre. Beaucoup d’artistes utilisent déjà des outils algorithmiques (correction de pitch, quantification, séparation de pistes, mastering automatisé, recommandations de samples). À partir de quel moment parle-t-on de « musique IA » ?

Trois catégories qui reviennent dans les débats

En 2025, la discussion se structure souvent autour de trois niveaux :

- Création humaine : composition, interprétation et production réalisées par des humains (avec des outils classiques).

- IA assistée : l’IA intervient comme outil (aide à la production, au mix, à la voix, au sound design), sans être l’auteur principal de l’œuvre.

- 100 % IA : la génération automatique produit l’essentiel du contenu musical, parfois à partir d’un simple prompt, avec un minimum d’intervention créative humaine.

Pourquoi la nuance compte pour les auditeurs… et pour l’économie

Pour l’auditeur, la nuance répond à deux besoins : comprendre l’intention artistique et choisir en connaissance de cause. Pour l’économie du streaming, la nuance évite un effet pervers : mettre dans la même case un album où l’IA a aidé au mastering et un flot de milliers de morceaux générés en série n’a pas de sens, ni en termes de perception, ni en termes de gestion du catalogue.

Le nœud du problème : la preuve et la responsabilité

Distinguer ces catégories suppose une information fiable : déclarations des ayants droit, métadonnées de distribution, signaux techniques (détection) et, dans certains cas, mécanismes de vérification. Mais la responsabilité est partagée : si les plateformes veulent afficher, elles doivent pouvoir recevoir des données structurées ; si les distributeurs livrent, ils doivent cadrer les déclarations ; et si les créateurs publient, ils doivent éviter les pratiques trompeuses (usurpation d’identité d’artistes, faux profils, métadonnées manipulées).

Quels sont les enjeux d’éthique, de droits d’auteur et de rémunération ?

L’IA générative rouvre de vieux débats (attribution, originalité, plagiat) à une échelle inédite. Le streaming, parce qu’il organise la visibilité et distribue l’argent, se retrouve au centre de la tension.

La question des données d’entraînement et du consentement

Un point cristallise les critiques : l’utilisation potentielle d’œuvres protégées pour entraîner des modèles, sans autorisation claire ni compensation jugée suffisante. Dans les études d’opinion publiées en 2025, l’idée d’un entraînement « par défaut » est largement perçue comme problématique. Le sujet dépasse le streaming : il touche à la gouvernance des modèles, au respect du droit d’auteur et à la capacité des créateurs à garder la main sur leurs œuvres et leurs « signatures » (voix, style, identité sonore).

Le streaming face à la fraude : quand l’IA sert à industrialiser le spam

Une autre dimension, plus opérationnelle, pèse lourd : la fraude. Le modèle économique du streaming repose sur des volumes d’écoutes, ce qui attire mécaniquement les tentatives de manipulation. Un flot de titres générés en série peut être utilisé pour saturer les catalogues, capter des micro-royalties, ou alimenter des fermes de streams. Les plateformes répondent par des filtres anti-spam, des règles de paiement et des systèmes de détection destinés à repérer les comportements artificiels.

ACPS : vers une rémunération plus « centrée sur l’engagement » ?

Sur la rémunération, Deezer met en avant l’Artist-Centric Payment System (ACPS), un modèle qui vise à mieux aligner la distribution des revenus sur l’engagement réel des fans et à réduire l’intérêt économique de certaines pratiques opportunistes. Dans ses communications, la plateforme décrit plusieurs mécanismes : plafonnement de l’impact d’un utilisateur sur l’enveloppe de redevances, valorisation des artistes avec une base d’auditeurs engagés, exclusion de certains contenus fonctionnels (bruits, sons parasites) des calculs, et nettoyage du catalogue pour limiter le poids du contenu non écouté ou frauduleux.

Ce type d’approche intéresse particulièrement le débat sur l’IA : plus il devient facile de produire des volumes, plus la rémunération « à l’échelle » peut être détournée. Un modèle qui favorise l’engagement plutôt que la quantité vise, en théorie, à rendre l’écosystème moins vulnérable aux stratégies industrielles de publication massive.

Quel impact la musique générée par IA a-t-elle sur la découverte musicale et les recommandations ?

La découverte musicale est le cœur du streaming : playlists, radios, mixes infinis, pages d’accueil personnalisées. Or l’IA générative change deux paramètres clés : le volume de nouveautés et la nature des signaux.

Quand la quantité dilue la visibilité

Plus la masse de titres augmente, plus la compétition pour une place dans les recommandations devient intense. Le risque est double : d’un côté, des contenus pertinents (artistes émergents, niches, scènes locales) peuvent être noyés ; de l’autre, des contenus standardisés peuvent mieux coller à des schémas algorithmiques et capter de la visibilité, même si l’intérêt artistique est discutable. En 2025, la bataille se déplace : il ne s’agit plus seulement de recommander « ce qui ressemble à vos goûts », mais de recommander « ce qui mérite votre temps ».

Filtrer, classer, déprioriser : les nouvelles manettes de la recommandation

Les plateformes expérimentent des leviers de gouvernance algorithmique. Deezer, par exemple, a communiqué sur une politique consistant à retirer les contenus 100 % générés par IA des recommandations algorithmiques et à ne pas les intégrer aux playlists éditoriales. Cette logique traduit une posture : la plateforme ne bannit pas nécessairement l’existence de ces titres, mais choisit de ne pas les amplifier par défaut.

Spotify, de son côté, a annoncé un renforcement des dispositifs anti-spam, visant à identifier et stopper la recommandation de contenus associés à des tactiques de manipulation (uploads massifs, duplications, stratégies d’exploitation des règles de rémunération). Là encore, l’enjeu est moins esthétique que structurel : préserver la recommandation comme outil de découverte, et non comme surface d’exploitation.

Flow et la découverte contextuelle : l’IA côté expérience

Il faut distinguer deux IA très différentes : l’IA qui génère des chansons, et l’IA qui aide à explorer un catalogue. Sur ce second volet, l’IA est installée depuis longtemps dans le streaming, mais elle se raffine. Chez Deezer, Flow illustre cette logique : un mix infini qui combine favoris et nouveautés, et qui s’ajuste à des préférences, des humeurs et des genres. L’idée n’est pas de remplacer la curation humaine, mais de la compléter par des modèles capables de s’adapter au contexte d’écoute.

Quelles fonctionnalités IA changent concrètement l’expérience des auditeurs ?

Pour le public, l’IA est souvent invisible… jusqu’au moment où elle pose un problème (contenu trompeur, saturation, recommandations dégradées). Pourtant, en 2025, plusieurs usages concrets émergent clairement.

1) Des repères pour choisir : labels, filtres, crédits

Le bénéfice le plus direct, côté auditeur, est la capacité à savoir (ou au moins suspecter) si un contenu est 100 % généré par IA. Un étiquetage clair évite la sensation de découverte piégée et redonne un pouvoir de décision : écouter par curiosité, éviter par principe, ou filtrer selon le moment. Dans certaines enquêtes d’opinion, une part importante des répondants exprime d’ailleurs le souhait de pouvoir filtrer ces contenus.

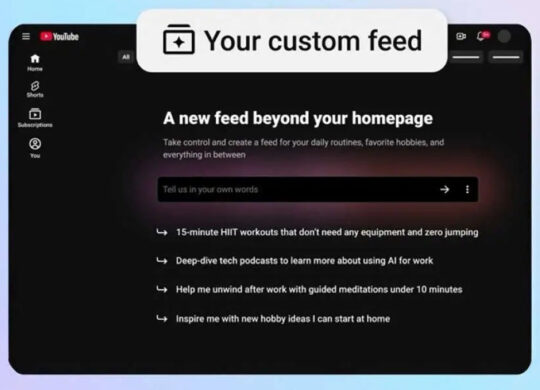

2) Des recommandations plus pilotables

Les auditeurs attendent de plus en plus des recommandations qu’elles soient contrôlables : plus de nouveautés, plus de classiques, un mood spécifique, un genre, un niveau d’énergie. Les mixes adaptatifs et les systèmes de découverte évoluent dans ce sens, avec une personnalisation plus fine et une place accrue donnée au contexte (activité, humeur, rythme d’écoute).

3) Une lutte plus visible contre le « bruit » du catalogue

Le streaming est historiquement vulnérable aux contenus fonctionnels (sons de pluie, bruits blancs, pistes ultra-courtes) et, désormais, aux fermes de contenus générés. Quand les plateformes communiquent sur le nettoyage de catalogue, l’exclusion de contenus parasites des calculs de royalties ou la suppression de pistes frauduleuses, elles répondent indirectement à une demande utilisateur : retrouver une découverte utile, qui ne ressemble pas à un flux d’objets optimisés pour l’algorithme.

4) Une personnalisation qui pose aussi des questions

Enfin, l’IA côté expérience n’est pas neutre : plus les recommandations deviennent performantes, plus elles peuvent enfermer dans des habitudes (effet bulle), favoriser des schémas rentables (durées, structures) ou donner une impression d’uniformisation. C’est l’un des paradoxes de 2025 : l’IA promet la diversité… mais peut aussi industrialiser le moyen si les incitations économiques et les mécanismes de visibilité ne sont pas bien cadrés.

Quelles différences entre Deezer, Spotify, Apple Music, YouTube Music et SoundCloud en 2025 ?

Les stratégies varient : certaines plateformes privilégient la transparence via des labels visibles, d’autres misent sur les métadonnées et les standards, d’autres encore renforcent surtout les règles d’upload et la lutte anti-spam. Le tableau ci-dessous synthétise les tendances observées en 2025 (avec une attention particulière aux annonces publiques et aux politiques documentées).

| Critère |

Deezer |

Spotify |

Apple Music |

YouTube / YouTube Music |

SoundCloud |

| Transparence « IA » visible |

Étiquetage annoncé pour identifier des contenus générés par IA (approche orientée lisibilité) |

Orientation crédits + métadonnées via un standard de divulgation (DDEX) |

Politiques d’acceptation plus strictes côté distribution (auteur/disclosure) |

Obligation de divulguer les contenus altérés/synthétiques lorsqu’ils paraissent réalistes |

Position en évolution : débat public sur IA, consentement et usages |

| Lutte anti-spam / fraude |

Détection, exclusion de streams artificiels et politiques de dépriorisation |

Nouveau filtre anti-spam annoncé, renforcement contre l’usurpation d’identité |

Rejets plus fréquents de contenus jugés peu travaillés/répétitifs (selon règles de distribution) |

Modération et règles de monétisation/disclosure selon les cas |

Mise en avant d’usages internes (reco, sécurité) et cadrage du training |

| Découverte & recommandations |

Flow : mix infini adaptatif (favoris + découvertes, humeurs/genres) |

Personnalisation forte, mais accent 2025 sur la protection contre les contenus de faible qualité |

Personnalisation et éditorialisation, approche plus contrôlée côté distribution |

Découverte via l’écosystème vidéo + musique, mais attention au réalisme synthétique |

Découverte d’artistes et outils orientés créateurs, avec débat sur la gouvernance IA |

| Modèle de rémunération |

ACPS / modèle « centré sur l’artiste » mis en avant (engagement, anti-fraude, nettoyage) |

Modèle majoritairement pro-rata, règles anti-fraude renforcées |

Modèle pro-rata, forte dépendance aux politiques de distribution |

Monétisation dépendante des règles de la plateforme (vidéo, droits, disclosure) |

Monétisation selon programmes et conditions, discussion publique sur IA et consentement |

Ce qui ressort, au-delà des différences, c’est une direction commune : en 2025, la compétitivité ne se joue plus seulement sur le catalogue et l’interface, mais sur la capacité à garantir une expérience propre (moins de spam), explicable (plus de transparence) et acceptable (meilleure éthique perçue).

FAQ : que faut-il retenir en pratique ?

Les plateformes peuvent-elles vraiment savoir si un morceau est généré par IA ?

Elles peuvent s’en approcher via deux voies : la déclaration (métadonnées, crédits, standardisation) et la détection (analyse technique, signaux associés à certains générateurs). Mais aucune méthode n’est parfaite : les outils évoluent vite, et la fiabilité dépend du périmètre (100 % IA vs IA assistée).

Étiqueter la musique IA, est-ce forcément « punir » les créateurs qui utilisent des outils modernes ?

Non, si l’étiquetage est nuancé. L’enjeu est justement de distinguer l’IA comme aide à la production (usage courant) et l’IA comme génération massive de titres sans intention artistique claire. Les standards de crédits visent à décrire l’usage de l’IA plutôt qu’à coller une étiquette simpliste.

Pourquoi la fraude est-elle liée à l’IA ?

Parce que l’IA réduit le coût de production de contenus diffusables à grande échelle. Couplée à des bots, elle peut alimenter des stratégies de manipulation (streams artificiels, inondation de catalogues). D’où le renforcement des filtres anti-spam et des règles de paiement.

Est-ce que la musique générée par IA va ruiner la découverte musicale ?

Pas forcément. La découverte dépend surtout de la manière dont les plateformes gouvernent la visibilité : filtres, règles de recommandation, transparence, lutte contre le bruit. L’IA peut enrichir l’exploration (moods, mixes adaptatifs), mais elle exige des garde-fous pour éviter la saturation.

En tant qu’auditeur, que puis-je faire dès maintenant ?

Regarder les labels et crédits quand ils existent, utiliser les boutons « j’aime / je n’aime pas » pour guider les recommandations, privilégier les playlists éditoriales si l’on cherche de la curation humaine, et signaler les contenus manifestement trompeurs (usurpation d’identité d’artistes, faux profils) quand la plateforme le permet.

![image produit Xiaomi Mi 10 Lite 5G Smartphone 6GB 128GB 6.57'' AMOLED 48MP Quad-caméra 4160mAh (Typical) NFC Bleu [Version Globale]](https://kulturegeek.fr/comparateur/img_products/30977/smartphone-xiaomi-mi-10-lite-128go-5g-bleu-22517_thumb.jpg)