Mistral AI, l’entreprise française d’intelligence artificielle, annonce aujourd’hui le lancement de Mistral 3, sa nouvelle famille de modèles de langage. Cette génération inclut trois modèles compacts ainsi qu’une version majeure nommée Mistral Large 3. L’annonce a lieu peu de temps après la présentation de GPT-5.1 d’OpenAI, Gemini 3 de Google, Claude Opus 4.5 d’Anthropic ou encore DeepSeek-V3.2.

Mistral Large 3 : puissance et open source

Le fer de lance de cette annonce, Mistral Large 3, marque une évolution significative dans les capacités de pré-entraînement de la société. Il s’agit d’un modèle Mixture-of-Experts (MoE) clairsemé, le premier du genre depuis la famille Mixtral. Entraîné à partir de zéro sur 3 000 GPU Nvidia H200, il totalise 675 milliards de paramètres, dont 41 milliards sont actifs lors de l’inférence.

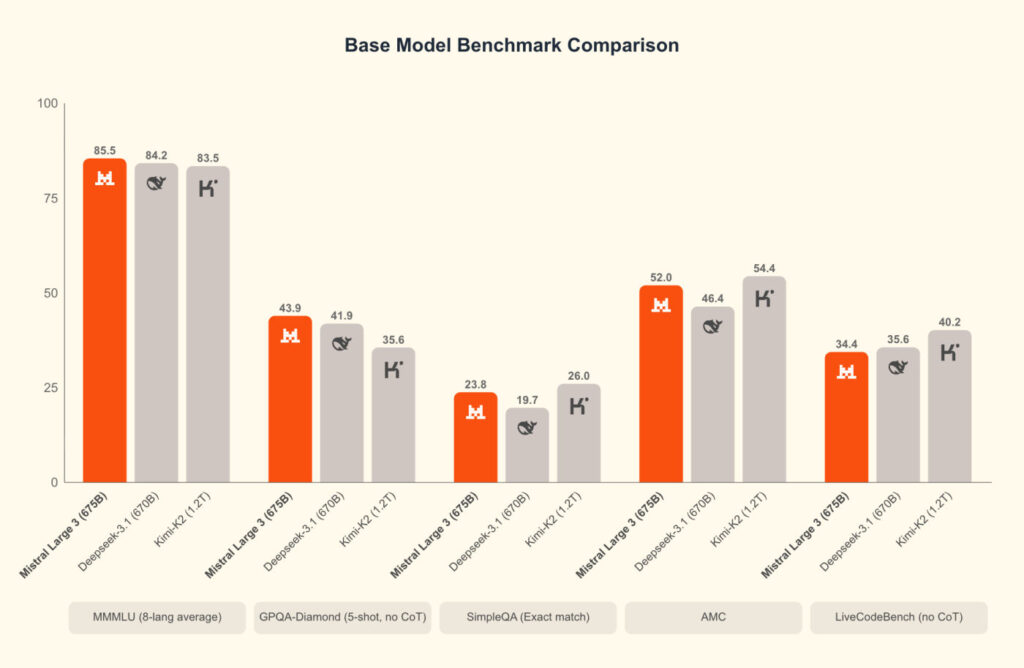

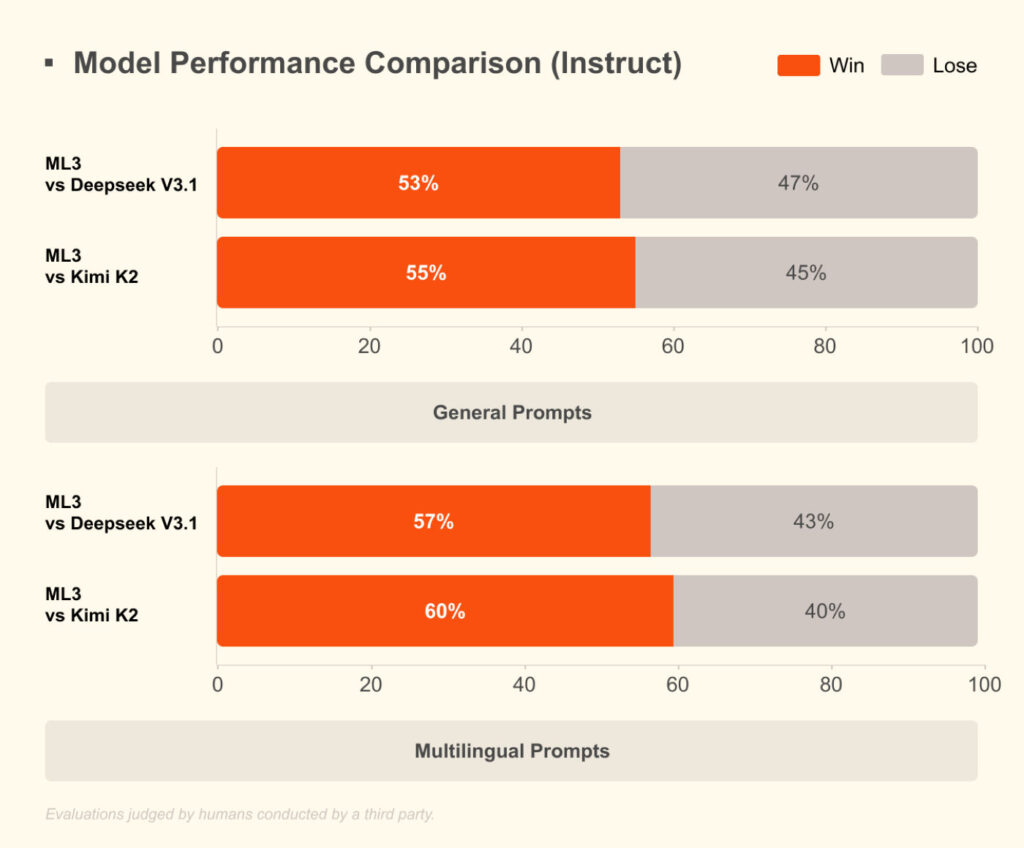

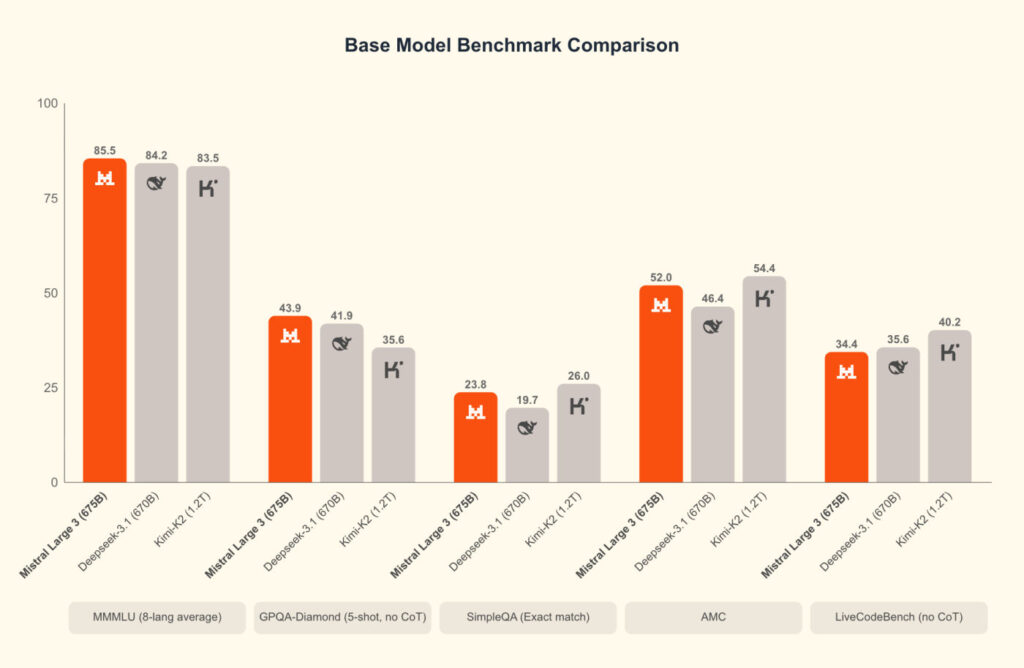

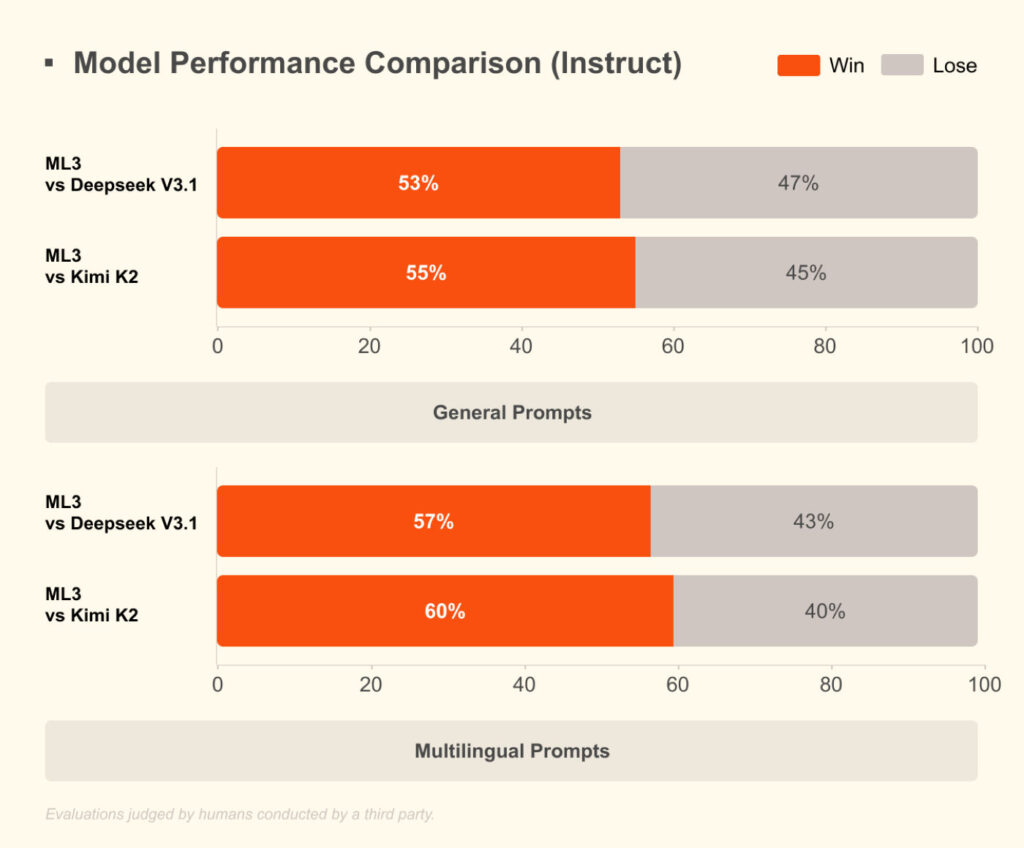

Ce modèle rivalise avec les meilleures solutions open-weight actuelles. Il démontre des compétences avancées en compréhension d’images et excelle dans les conversations multilingues, particulièrement en dehors du couple anglais-chinois. Sur le classement LMArena, il fait ses débuts à la deuxième place dans la catégorie des modèles open source sans raisonnement.

Bien que les versions de base et d’instruction soient disponibles immédiatement pour permettre la personnalisation en entreprise, une variante axée sur le raisonnement est prévue prochainement.

Pour garantir une accessibilité maximale, Mistral a collaboré étroitement avec Nvidia, Red Hat et vLLM. Ce partenariat a permis une co-conception logicielle et matérielle approfondie :

- Formats optimisés : un point de contrôle au format NVFP4, conçu avec llm-compressor, est disponible pour une exécution efficace.

- Compatibilité serveur : Mistral Large 3 peut tourner sur un nœud unique 8×A100 ou 8×H100, ainsi que sur les systèmes Blackwell NVL72.

- Intégration technique : Nvidia a intégré un support de pointe avec Blackwell et prend en charge l’inférence efficace via TensorRT-LLM pour toute la famille Mistral 3.

Ces efforts permettent aux développeurs de gérer des charges de travail à haut débit et à long contexte, du data center jusqu’aux robots.

Ministral 3 avec de l’efficacité et du raisonnement

Pour les cas d’usage locaux et Edge, l’entreprise propose la famille de modèles Ministral 3. Elle se décline en trois tailles de paramètres : 3B, 8B et 14B. Contrairement au modèle Large, ces versions denses sont d’ores et déjà proposées en trois variantes : base, instruction et raisonnement.

La gamme Ministral vise le meilleur rapport performance-coût du marché. Dans des conditions réelles, ces modèles égalent ou surpassent leurs concurrents tout en générant souvent beaucoup moins de tokens, ce qui accroît leur efficacité.

La variante de raisonnement de 14 milliards de paramètres illustre cette performance en atteignant 85 % sur le benchmark AIME ’25. Ces modèles intègrent également des capacités natives de compréhension d’image, offrant une solution complète pour les besoins des développeurs.

2 commentaires pour cet article :