TENDANCES

Comparateur

- AUTO

Microsoft vient de dévoiler Phi-3 Mini, la première version de sa nouvelle série de modèles d’IA « léger » conçue pour offrir de puissantes capacités d’IA dans un format plus compact et efficace. Avec 3,8 milliards de paramètres, Phi-3 Mini est conçu pour fonctionner de manière robuste même s’il est formé sur un ensemble de données plus petit que d’autres modèles plus imposants comme GPT-4. Désormais disponible sur des plateformes telles qu’Azure, Hugging Face et Ollama, Microsoft positionne Phi-3 Mini comme un précurseur des prochaines versions de Phi-3 Small et Phi-3 Medium, qui compteront respectivement 7 milliards et 14 milliards de paramètres. Cette évolution reflète une tendance croissante de l’industrie vers le développement de modèles d’IA performants mais plus économes en ressources.

Le développement de Phi-3 Mini s’appuie sur le succès de son prédécesseur, Phi-2, qui était réputé pour égaler les performances de LLMs plus vastes. Selon Microsoft, Phi-3 Mini surpasse non seulement Phi-2 en termes de capacités, mais se rapproche également des performances de LLM dix fois plus grands, ce qui suggère des progrès significatifs en termes d’efficience et d’efficacité. Eric Boyd, vice-président de Microsoft Azure AI Platform, a souligné que le Phi-3 Mini rivalise avec des LLMs comme GPT-3.5, offrant une puissance d’IA substantielle dans un « facteur de forme plus petit ». Cette approche s’aligne sur l’évolution de l’industrie vers des modèles moins coûteux à exploiter et mieux adaptés aux appareils personnels tels que les smartphones et les ordinateurs portables.

Au-delà de Microsoft, l’industrie dans son ensemble semble se diriger vers une adoption plus large de modèles d’IA plus petits, adaptés à des tâches spécifiques telles que la synthèse de documents et l’assistance au codage. Google et Anthropic développent également de petits modèles d’IA, chacun doté de capacités uniques destinées à des applications de niche. Les méthodes de formation innovantes de Microsoft pour Phi-3, qui impliquaient notamment la création de « livres pour enfants » synthétiques afin de simuler des processus d’apprentissage plus simples, dévoilent une approche créative de l’entraînement de ce LLM. Malgré leur taille réduite, les modèles comme Phi-3 Mini s’avèrent plus adaptables et plus économiques pour les entreprises, en particulier lorsqu’ils sont appliqués à des ensembles de données internes généralement plus petits.

La start-up Humane, qui est derrière le produit AI Pin, connaît de sérieuses difficultés et essaie maintenant de trouver un...

Google a décidé d’améliorer le respect de la vie privée des utilisateurs profitant de Google Maps en stockant leur...

Un tribunal britannique a donné son feu vert à une plainte en nom collectif visant Google, accusé d’abus de position dominante...

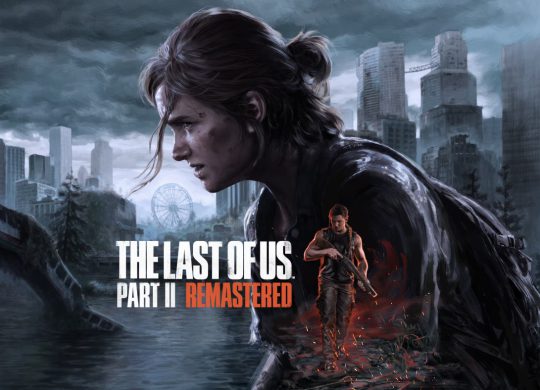

Les joueurs PlayStation peuvent déjà profiter de The Last of Us Part 2, mais ceux qui ont un PC doivent attendre. Et pourtant, le titre de...

Sony a décidé de ne plus indiquer le support de la 8K sur la boîte de la PlayStation 5. Le logo a tout simplement disparu. Il reste...