Un juge brésilien a été sommé de s’expliquer après sa mésaventure qui concerne l’utilisation d’une intelligence artificielle (ChatGPT) pour rédiger sa sentence. Elle contenait des références erronées.

Le Conseil national de justice (CNJ), organe public chargé de veiller au bon fonctionnement du système judiciaire, a demandé au magistrat Jefferson Rodrigues d’expliquer comment il en était venu à rendre une décision truffée d’erreurs. Ce juge fédéral de l’État d’Acre (nord) a utilisé comme fondement de sa décision de faux éléments de jurisprudence attribués au Tribunal supérieur de justice (STJ), une des plus hautes instances judiciaires du Brésil.

Selon un document du CNJ consulté lundi par l’AFP, le magistrat a dit avoir confié l’élaboration de cette sentence à un collaborateur de confiance qui s’est aidé de l’outil ChatGPT. Les erreurs « ont eu lieu en raison de l’utilisation d’un outil virtuel qui s’est révélé inadéquat », a reconnu le juge. Il a attribué cette « simple erreur » à « la surcharge de travail » des magistrats brésiliens. « Nous pensons qu’il s’agit du premier cas de ce type », a dit le CNJ, donnant 15 jours au magistrat pour fournir des explications plus approfondies.

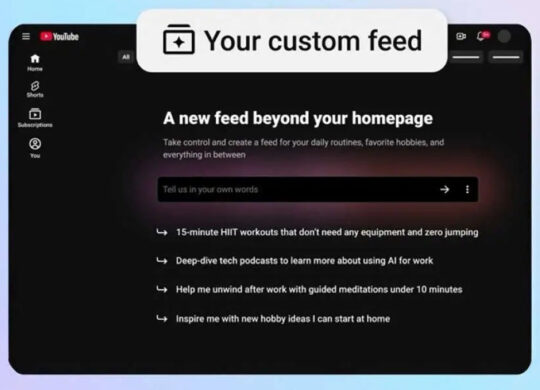

Selon cet organe, le recours à l’intelligence artificielle est de plus en plus courant dans les tribunaux brésiliens, où cette technologie n’a pas encore été encadrée par la loi.

![image produit GTA V [import anglais]](https://kulturegeek.fr/comparateur/img_products/67526/grand-theft-auto-v-ps4-import-anglais-49490_thumb.jpg)