TENDANCES

Comparateur

- AUTO

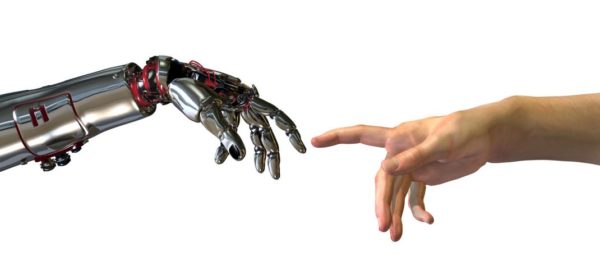

Une équipe du MIT du laboratoire Computer Science and Artificial Intelligence Laboratory (CSAIL) a mis au point une IA prédictive capable de « voir » en touchant et de « ressentir » en voyant. Reliée à un bras-robot KUKU et un capteur tactile GelSight, l’IA du MIT a analysé plus de 12000 « touchers » de 200 objets différents et près de 3 millions d’images « visuelles/tactiles » (baptisées VisGel).

Résultat de ce bombardement de données : l’IA prédictive est désormais capable de prédire la sensation et le toucher d’un objet simplement en le regardant… et inversement. Le couple bras-robot + IA prédictive peut aussi déterminer à l’aveugle la forme visuelle d’un objet en le touchant/manipulant, ainsi que pourrait le faire un être humain.

Cette innovation est d’importance dans le domaine robotique : assisté de ce type d’IA prédictive, un robot saura dorénavant déterminer la forme d’un objet simplement en le saisissant, ce qui facilitera les manipulations d’objets non référencés par le robot. Les manipulations « à l’aveugle » seront aussi essentielles pour les robots d’assistance, notamment dans les environnements de catastrophes: la machine pourra intervenir sans aucune luminosité extérieure ou artificielle.

Meta a pris la décision de ne pas signer le code de bonne conduite de l’AI Act, la législation de l’Union européenne...

Netflix a partagé la liste des séries et des films qui ont été les plus regardés sur sa plateforme de streaming en...

La firme de Redmond n’en a décidément pas fini avec la restructuration de ses activités : Microsoft a en effet brusquement...

Le français Mistral annonce une série de nouvelles fonctionnalités pour son assistant Le Chat, le rapprochant des géants du...

Le gouvernement français relance son initiative visant à interdire l’accès aux réseaux sociaux pour les mineurs de moins...