L’intelligence artificielle générative s’invite dans le secteur de l’imagerie médicale… et ce n’est pas pour le meilleur. Une étude récemment publiée montre en effet que des radiographies synthétiques produites par IA sont désormais suffisamment crédibles pour tromper des spécialistes entraînés à détecter les moindres anomalies visuelles. Ce constat ouvre un champ de vulnérabilités très concret (et très inquiétant) pour les hôpitaux, les patients, et plus généralement pour l’ensemble de la chaîne de confiance qui repose sur l’authenticité des images médicales.

Des faux clichés médicaux de plus en plus difficiles à distinguer

Pour mesurer l’ampleur du phénomène, des chercheurs ont soumis un ensemble de radiographies réelles et d’images générées par ChatGPT à plusieurs radiologues en exercice, issus de différents pays et niveaux d’expérience. Les résultats sont loin d’être rassurants : lorsque les médecins ignoraient qu’ils étaient confrontés à des faux potentiels, leur capacité à les identifier chutait fortement (41% de détections d’IA). Même lorsqu’ils savaient que des images synthétiques se trouvaient dans le lot, leurs performances étaient loin du 100% de fiabilité (75% de détections d’IA).

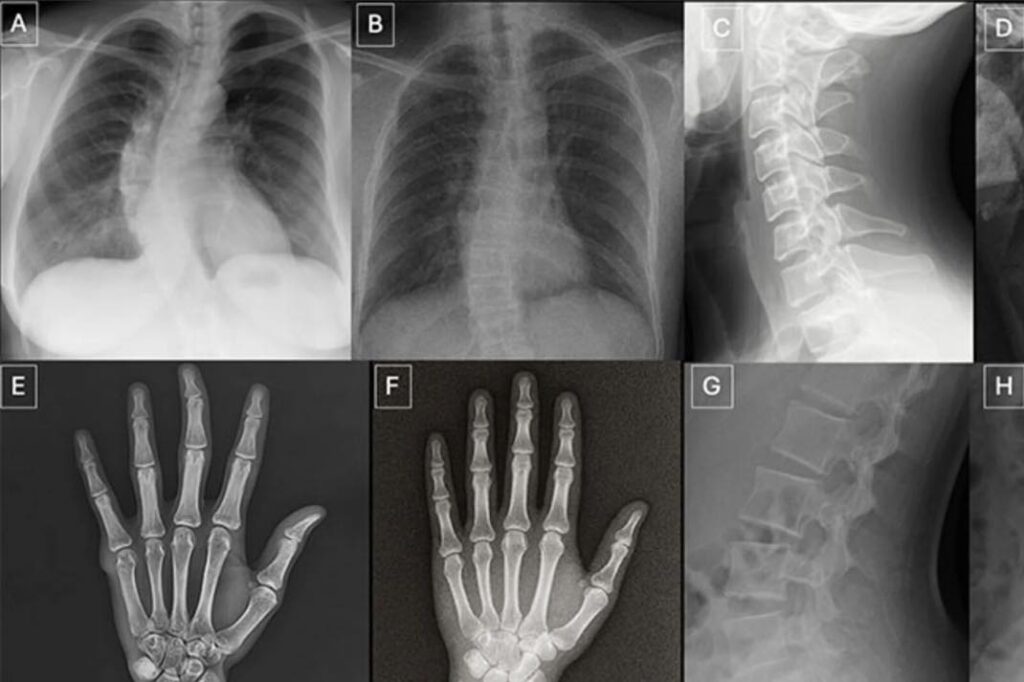

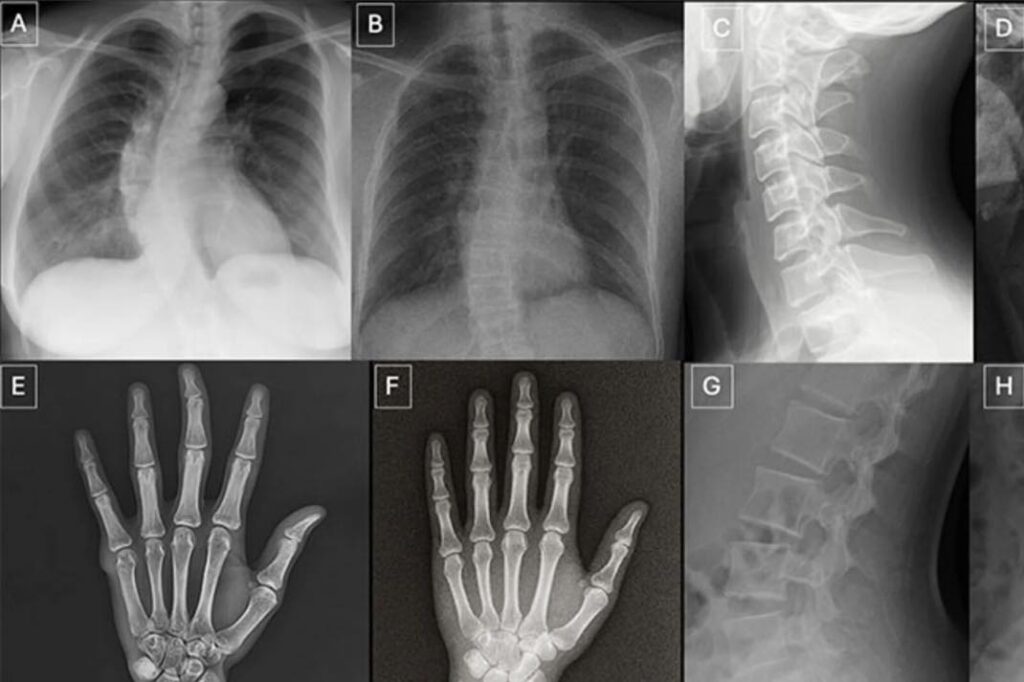

Ci-dessus : radiographies réelles et fausses générées par ChatGPT-4o, correspondant à la même anatomie. A, C, E et G sont réelles. Les autres sont des faux. © Radiological Society of North America (RSNA)

Le plus troublant est que ces faux ne se limitaient pas à des images grossières. Ces présentaient des structures anatomiques suffisamment cohérentes pour semer le doute, y compris chez des experts formés à l’analyse d’images complexes. Plus inquiétant encore, la même éttude montre également que certains modèles d’IA multimodaux – ici ChatGPT-4o/5, Google’s Gemini 2.5 Pro, et Meta’s Llama 4 Maverick – peinent à repérer les radiographies artificielles, y compris lorsqu’ils évaluent des images créées à l’aide de technologies proches, ce qui signifie qu’il n’existe pas à l’heure actuelle de systèmes capables de détecter de façon fiable les fausses radios générées par l’IA.

Un risque majeur de fraude

Les implications de cette étude dépassent largement le cadre académique. Des radiographies falsifiées pourraient être utilisées dans des contentieux médicaux ou des procédures d’assurance, par exemple pour faire croire à une fracture, à une lésion ou à une aggravation inexistante. Dans un univers où l’image médicale constitue souvent une preuve décisive, la perspective de faux documents visuellement convaincants devient un problème aussi bien juridique que clinique.

Les hôpitaux pourraient aussi devenir des cibles

L’autre menace concerne la cybersécurité. Si des pirates parvenaient à injecter des images synthétiques dans les systèmes hospitaliers, ces derniers pourraient alors perturber des diagnostics, semer la confusion dans les dossiers patients et fragiliser la confiance dans les archives médicales numériques. Autrement dit, le danger ne vient pas seulement de l’extérieur : il touche aussi l’intégrité même des infrastructures de santé.

Former, détecter et sécuriser devient urgent

Face à cette montée des deepfakes médicaux, les chercheurs plaident pour la création d’outils de détection dédiés, de bases d’entraînement pédagogiques et de protocoles renforcés d’authentification des images. Certains indices reviennent déjà souvent dans les faux les plus convaincants : os trop lisses, colonne vertébrale anormalement droite, symétrie excessive des poumons ou fractures dessinées avec une netteté suspecte. Mais ces « marqueurs d’IA » ne suffiront pas longtemps à donner le change à mesure que les modèles génératifs progresseront (et ils progressent vite).