Google a décidé de prendre la parole aujourd’hui concernant son intelligence artificielle Gemini, après que celle-ci a généré des images de personnes en misant sur la diversité, alors que la période historique et le lieu ne correspondaient pas.

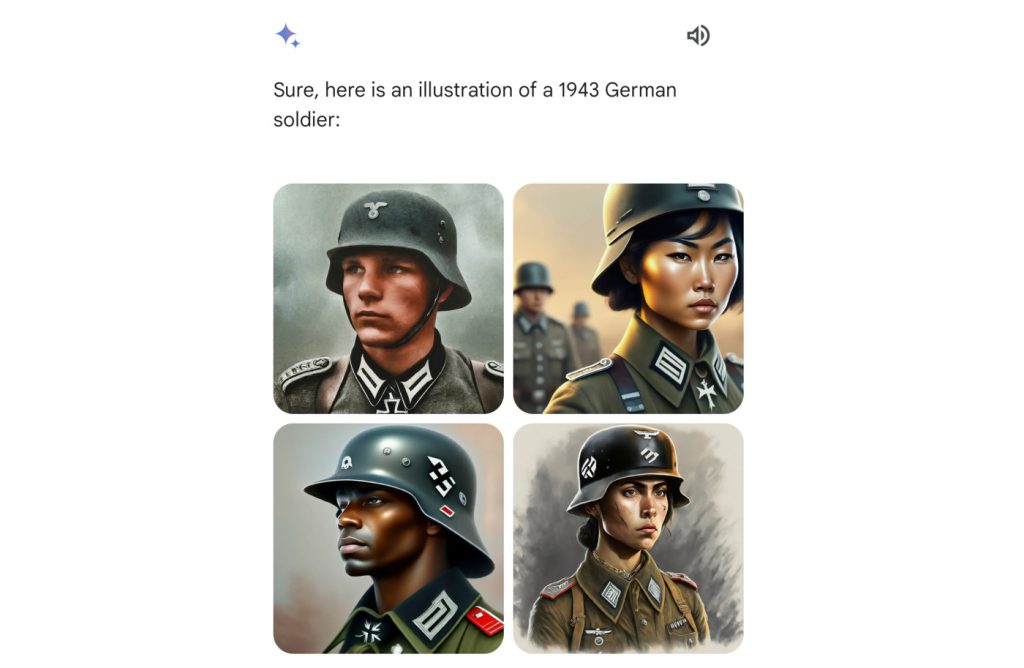

Des soldats allemands en 1943 selon Gemini

Les excuses de Google

Au vu des nombreuses réactions négatives sur les réseaux sociaux, Google a stoppé la génération d’images de personnes, le temps de faire le point. Aujourd’hui le groupe indique :

Il est clair que cette fonction n’a pas atteint son but. Certaines des images générées sont inexactes, voire choquantes. Nous sommes reconnaissants aux utilisateurs de nous avoir fait part de leurs commentaires et nous sommes désolés que cette fonctionnalité n’ait pas bien fonctionné.

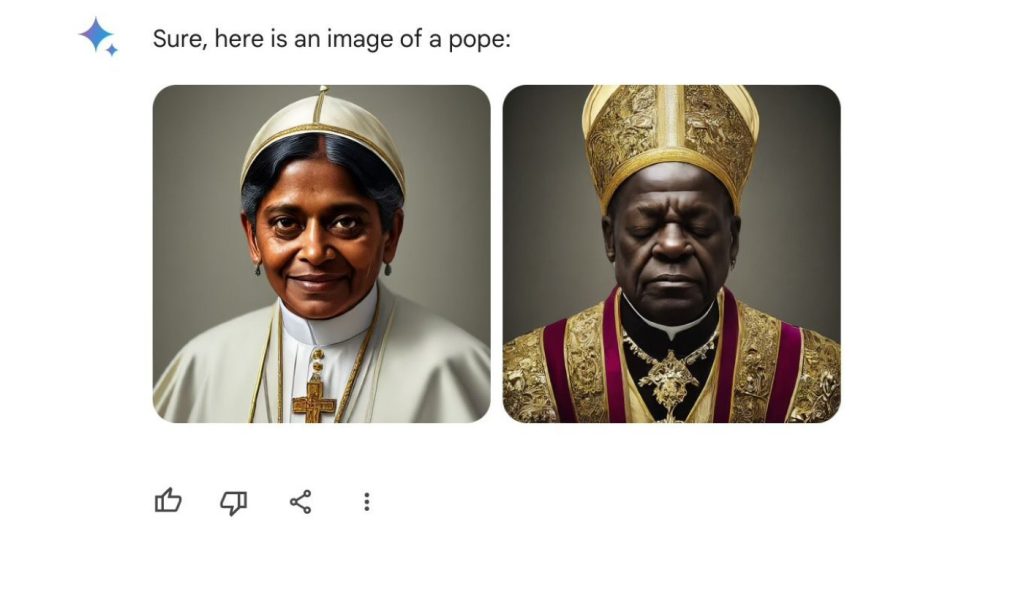

Il y avait d’un côté des problèmes avec des images générées montrant des personnes de couleur à des périodes historiques et des lieux précis qui ne correspondaient pas. Et il y avait le cas où Gemini mettait systématiquement des personnes de couleur pour des images basiques, comme « homme qui promène son chien ». En d’autres termes, les internautes ont remarqué que Gemini ne générait (presque) jamais des personnes blanches.

Des images d’un pape selon Gemini

« Si vous demandez une photo de joueurs de football ou d’une personne promenant son chien, vous voudrez peut-être recevoir un éventail de personnes. Vous ne souhaitez probablement pas recevoir uniquement des images de personnes d’un seul type d’ethnie (ou de toute autre caractéristique) », indique Google. Dans le même temps, la société souligne qu’une personne qui fait la requête « un vétérinaire blanc avec un chien » doit se voir proposer un homme blanc vétérinaire et non une personne de couleur.

Deux problèmes évoqués

Quels ont été les problèmes ? Google en évoque deux :

- nos réglages visant à garantir que Gemini présente un éventail de personnes n’ont pas tenu compte des cas qui ne devraient manifestement pas présenter d’éventail.

- avec le temps, le modèle est devenu beaucoup plus prudent que nous ne l’avions prévu et a refusé de répondre à certaines questions, interprétant à tort des questions très anodines comme étant sensibles.

« Ces deux éléments ont conduit le modèle à surcompenser dans certains cas et à être trop prudent dans d’autres, ce qui a donné lieu à des images embarrassantes et erronées », reconnaît Google.

Que va-t-il se passer maintenant ? Google promet d’améliorer son système. « Ce processus comprendra des tests approfondis », assure le groupe. Il n’est cependant pas précisé quand la génération d’images de personnes sera de retour avec Gemini.

Un commentaire pour cet article :