Instagram annonce agrandir sa liste de contenus interdits sur sa plateforme. Les nouveaux éléments sont les images susceptibles d’encourager le suicide ou l’automutilation, en y ajoutant les dessins et autres contenus fictifs.

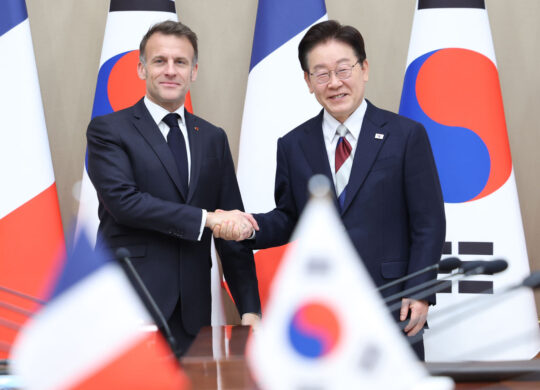

« Nous n’autoriserons plus de représentations fictives d’automutilation ou de suicide sur Instagram, telles que des dessins ou du contenu de films ou de bandes dessinées », a déclaré Adam Mosseri, le patron d’Instagram. « Nous retirerons également les images qui ne montrent pas (directement) l’automutilation ou le suicide mais sont relatives aux matériaux ou méthodes s’y associant », a-t-il ajouté.

La décision d’interdire de telles images avait été prise alors que le père d’une jeune Britannique, Molly Russell, qui s’est suicidée en 2017 à 14 ans, accusait Instagram d’avoir une responsabilité dans ce drame. L’adolescente avait, selon son père, consulté beaucoup de contenu lié au suicide ou à l’automutilation sur le réseau social. Adam Mosseri avait indiqué être « bouleversé » par cette mort.

« La réalité tragique est que certains jeunes sont influencés négativement par ce qu’ils voient en ligne et risquent donc de se blesser. C’est un risque réel », a précisé Adam Mosseri.

Instagram a indiqué que dans les trois mois ayant suivi le changement de politique, le service avait « réduit la visibilité de, ou ajouté des écrans de sensibilité » à plus de 834 000 éléments de contenu.