Comparateur

- AUTO

Les vidéos truquées à l’aide d’IA (appelées communément deepfakes) pourraient bien vite devenir l’arme de prédilection des « complotistes » ou des amateurs de fake-news (qui sont souvent les mêmes). Conscient des dérives possibles, le DARPA (la branche recherche du Pentagone) a signé plusieurs contrats de financement avec le groupe SRI International. L’objectif de ce partenariat est de mettre au point des outils permettant de repérer les vidéos truquées, sachant que les technologies logicielles de manipulation d’image progressent à grands pas.

L’affaire n’est pas « si » grave tant qu’elle reste limitée au « porno » (on se doute bien que la célébrité sur la vidéo n’est pas « vraiment » sur la vidéo, sans compter qu’il est facile de retrouver la vraie source), mais le trucage pourrait devenir beaucoup plus problématique dans le cadre de relations diplomatique, d’espionnage, de chantage politique, avec des vidéos montées de toutes pièces et qui pourraient faussement incriminer telle ou telle personne publique.

Le programme MediFor, lancé par le DARPA en 2015, est financé au moins jusqu’en 2020 et se fixe pour objectif de développer des technologies permettant de rendre compte « de la parfaite intégrité d’une image ou d’une vidéo« , en clair, de repérer tout trucage éventuel.

SOURCEtechcrunch

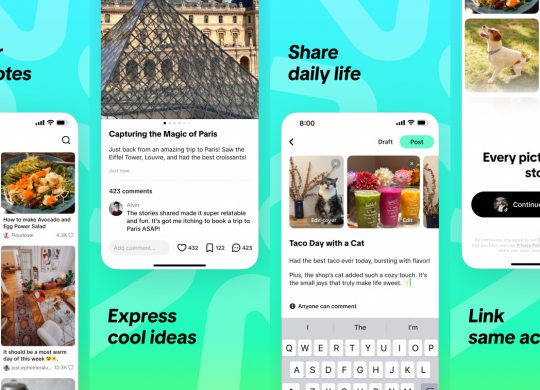

Après les rumeurs, place au lancement de TikTok Notes, un nouveau social qui vient concurrencer Instagram. Quelle différence avec TikTok qui...

Des scientifiques de l’Imperial College de Londres viennent de bouleverser le domaine de l’informatique quantique, un domaine qui cherche...

Mozilla propose la version stable de Firefox 125 au téléchargement et il ne s’agit pas d’une petite version. En effet, la mise...

Meta tape dur sur le secteur de l’IA. Ce même jour, la firme de Mark Zuckerberg annonce le lancement de Llama 3, un modèle de langage...

La Chambre américaine des représentants va à nouveau examiner une proposition de loi qui prévoit l’interdiction de...